jhs_v2.0.2aqk:鉴黄师如何高效识别违规内容并提升平台安全

数字内容平台面临的最大挑战之一,是快速识别并处理违规信息,尤其是涉及、暴力等不良内容。鉴黄师作为内容审核的核心角色,需结合技术工具与人工经验,构建高效审核体系,保障用户体验与平台合规性。将解析鉴黄师的核心工作逻辑及技术策略,探讨如何优化审核流程,提升平台安全。

鉴黄师的核心职责与技术原理

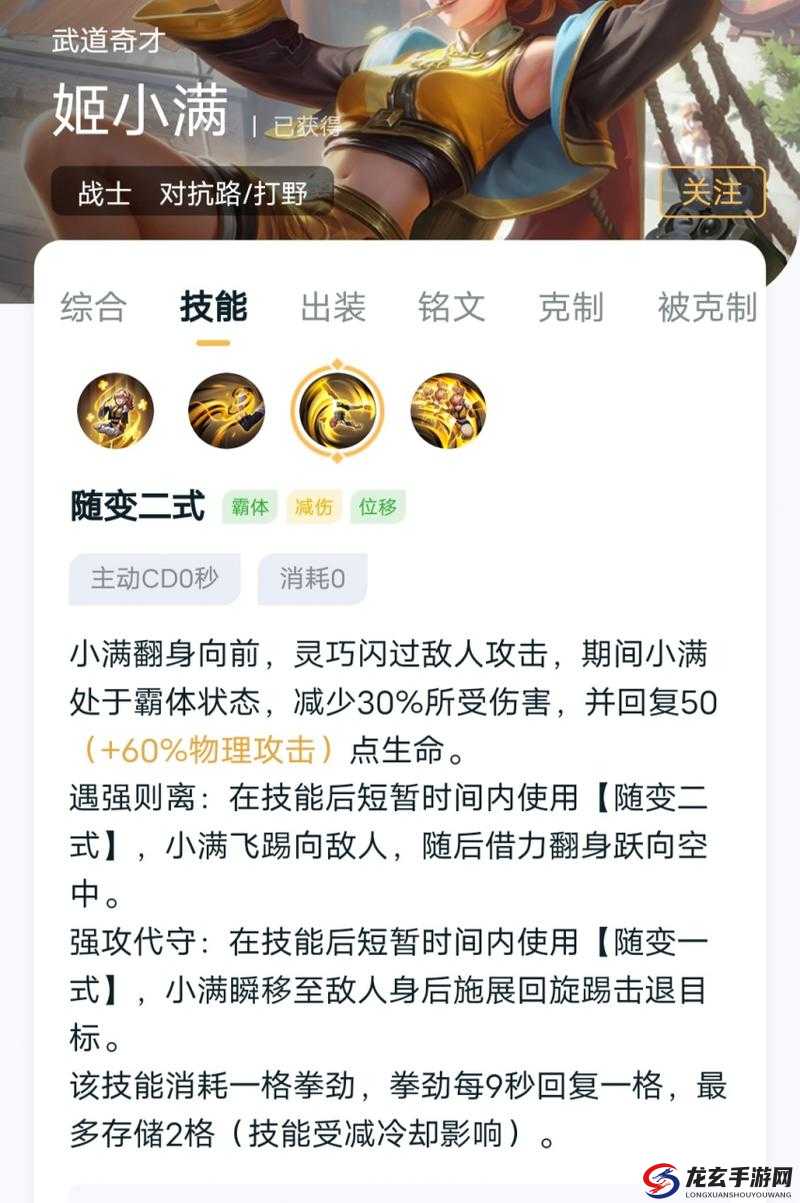

鉴黄师的主要任务是筛选用户上传的图片、视频及文本内容,判断其是否符合法律法规与平台规则。传统人工审核依赖经验积累,但面对海量数据时效率低下。现代审核体系通过AI技术实现初步过滤,鉴黄师则聚焦复杂案例的二次复核。

1. AI辅助识别技术

深度学习模型(如卷积神经网络)可识别图像中的敏感特征,例如肤色比例、肢体动作及文字信息。文本分析工具通过自然语言处理(NLP)检测关键词、上下文关联及隐喻表达。视频审核则依赖关键帧提取与动态行为分析。

2. 多模态内容分析

结合图像、音频、文本的多维度信息交叉验证,例如识别直播中的语音暗示与画面动作的关联性,降低误判率。

高效审核流程的三大优化方向

为应对内容规模的指数级增长,鉴黄师需优化流程设计,缩短响应时间,同时确保准确性。

1. 优先级分层机制

根据用户行为(如新注册账号、高频上传记录)及内容特征(如模糊图像、非常规格式)划分风险等级。高风险内容自动进入人工审核队列,低风险内容由AI直接处理。

2. 动态规则库更新

违规内容常以变体形式出现,例如谐音词、马赛克遮挡。鉴黄师需定期同步黑名单库,训练模型适应新样本。平台可建立用户举报反馈机制,实时补充违规案例。

3. 人机协同审核模式

AI完成首轮筛选后,鉴黄师对“疑似违规”内容进行最终判定。通过标注系统反馈模型错误,持续优化算法精度。

鉴黄师面临的挑战与解决方案

尽管技术大幅提升审核效率,但复杂场景仍依赖人工判断。以下为常见问题及应对策略:

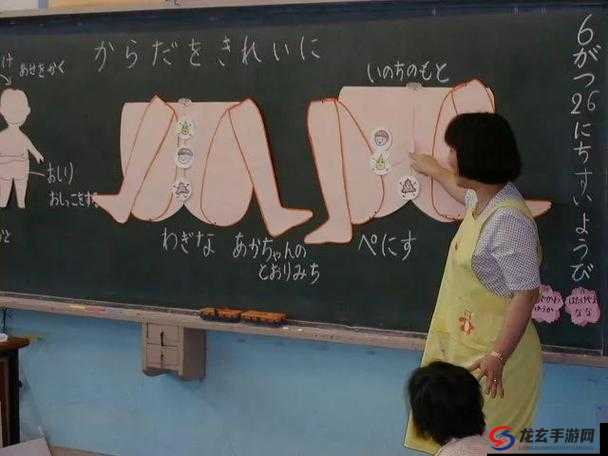

1. 文化差异与主观判断

不同地区对“违规”的定义存在差异。例如,某些艺术类图片可能被误判为内容。解决方案是建立多语言、多文化审核团队,并制定细化的审核标准文档。

2. 对抗性内容规避技术

违规用户可能使用深度伪造(Deepfake)、画面分割等技术绕过检测。鉴黄师需关注细节异常,如面部边缘模糊、光影不自然,并借助溯源工具追踪上传者历史行为。

3. 心理压力与职业保护

长期接触不良内容可能对鉴黄师心理健康造成影响。平台应提供心理辅导、轮岗机制及内容模糊化处理工具,降低负面情绪累积。

技术趋势与未来发展方向

内容审核领域的技术迭代持续加速,以下方向可能成为行业突破点:

1. 实时审核与边缘计算

5G网络与边缘计算技术推动实时审核能力,例如直播场景中,AI可在1秒内拦截违规画面,减少传播风险。

2. 小样本学习与迁移学习

针对罕见违规内容(如新型诈骗信息),模型需通过小样本训练快速适应,减少对标注数据的依赖。

3. 区块链存证与合规审计

利用区块链技术存储违规内容证据链,确保处理过程透明可追溯,满足监管要求。

平台安全的生态共建策略

单一依赖鉴黄师与AI技术不足以构建完整防线,需联合多方力量:

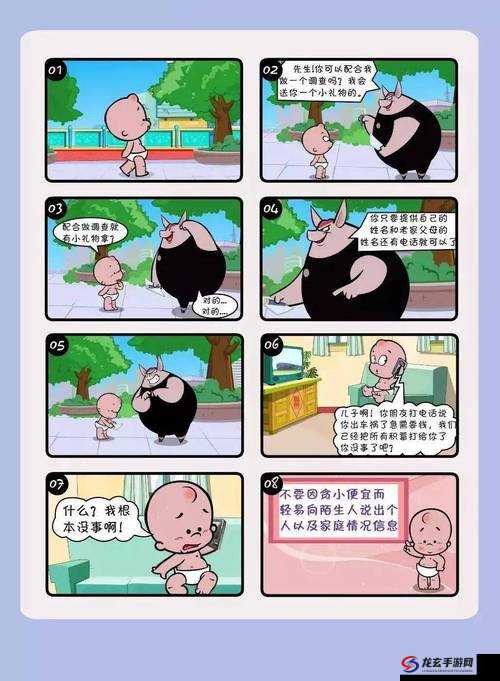

- 用户教育:通过弹窗提示、社区规则公示,引导用户自觉遵守内容规范。

- 行业协作:跨平台共享违规账号数据库,防止违规者转移阵地。

- 法律合规:定期审查审核规则与地方政策的匹配性,避免法律风险。

数字内容生态的治理是一场持久战。鉴黄师作为关键防线,需持续融合技术创新与人性化判断,在效率与安全之间找到平衡点,为平台与用户创造健康环境。